La frase “AI Slop” resuena con una frecuencia alarmante en nuestros diálogos digitales. Parece que apenas mencionamos la inteligencia artificial, la palabra “slop” (basura, desechable) ya está lista para seguirle, casi como un eco automático. Pero, ¿es realmente esta conexión tan superficial como parece? ¿Estamos, irónicamente, demostrando la misma predictibilidad que criticamos en las máquinas al usar esta etiqueta tan rápidamente? La pregunta no es solo sobre la tecnología, sino sobre nosotros mismos y cómo interactuamos con ella.

La discusión sobre la naturaleza de los modelos de lenguaje grande (LLMs) nos enfrenta a una fascinante paradoja. Un LLM, en su esencia, es un algoritmo diseñado para predecir la siguiente palabra más probable en una secuencia, similar a la función de autocompletado de Google. Se basa en patrones estadísticos encontrados en vastas cantidades de texto. Es una forma de “aprendizaje” que carece de comprensión contextual o intención real. Cada palabra generada es un cálculo basado en probabilidad, una conjetura educada sobre lo que viene a continuación, sin un sentido profundo o una conciencia de lo que se está construyendo.

Ahora bien, ¿qué sucede cuando nosotros, los humanos, usamos la frase “AI Slop”? Hay dos visiones principales. Una sugiere que es una elección consciente, una forma precisa de describir contenido generado por IA que efectivamente es de baja calidad, predecible o carece de originalidad – una “basura” en el sentido literal de la palabra. La otra visión, más crítica, argumenta que a menudo es una reacción instintiva, una forma de expresar desdén generalizado hacia la IA sin un análisis profundo. Que, en cierto modo, estamos haciendo lo mismo que la IA: eligiendo la palabra más “probable” o más fácil de usar en un momento de frustración o desconcierto, en lugar de articular una crítica más elaborada. ¿Estamos, en nuestro hastío, replicando el proceso predictivo que tanto criticamos?

Consideremos la naturaleza del lenguaje mismo. Las palabras y frases evolucionan, adoptan nuevos significados y se convierten en atajos para ideas complejas. “AI Slop” podría ser simplemente otra expresión que emerge para encapsular una sensación colectiva de agobio ante la proliferación de la IA en todos los aspectos de nuestra vida. Vemos su impacto en precios (almacenamiento, energía), en la huella ecológica y, para algunos, en una supuesta disminución de la creatividad humana. Esta oleada de presencia puede llevar a una reacción visceral, donde cualquier cosa generada por IA es tachada de “slop”, no porque sea intrínsecamente mala en ese momento, sino como una protesta contra la invasión generalizada. Es una forma de establecer una barrera emocional frente a algo que percibimos como abrumador o indeseado.

Pero aquí reside la complejidad. Existe un consenso creciente de que no toda la producción de IA es “slop”. Un modelo puede generar una respuesta precisa y útil, como decir “París es la capital de Francia”. ¿Es eso “slop”? Probablemente no. La crítica se dirige más frecuentemente al contenido que exhibe las características visuales o estructurales asociadas con la generación masiva: imágenes con bordes suaves pero extraños, texto que suena genérico o estereotipado, una falta de alma o originalidad. Ese “look” particular, esa sensación de “cookie cutter”, es lo que desencadena la etiqueta para muchos. Sin embargo, también es cierto que la frustración generalizada con la omnipresencia de la IA puede llevar a aplicar la etiqueta de forma más amplia, incluso a contenido que, objetivamente, no es malo, simplemente porque es de IA. Se convierte en un shorthand emocional: “GTFO con tu AI slop” significa, a menudo, “estoy harto de toda esta IA”.

La analogía que se propone es fascinante y, en cierto modo, perturbadora: si argumentamos que usar “AI Slop” es una reacción instintiva, siguiendo el camino de menor resistencia en nuestra comunicación, ¿no estamos describiendo una forma de “laziness” cognitiva similar a la que a veces criticamos en la IA? No es que estemos generando texto aleatorio, pero sí que podemos estar eligiendo la respuesta más fácil, la más común, la que ya está en el aire, en lugar de construir un argumento más sutil o una descripción más precisa. Es como si nuestro cerebro, al igual que el de una IA, buscara el patrón más probable para completar la idea: “AI… slop”.

La discusión se vuelve aún más profunda cuando consideramos las diferencias fundamentales. Un humano que elige la palabra “slop” lo hace con intención, para comunicar una valoración negativa basada en su juicio. Entiende el significado de la palabra y la aplica deliberadamente para hacer un punto. La IA, por otro lado, no “entiende” ni “juzga”. Genera la secuencia de palabras basándose en correlaciones estadísticas, sin conciencia de si su “creación” es buena, mala, o si tiene sentido en un contexto más amplio. Es una simulación de comunicación, no la comunicación misma. La analogía del humano forzado a responder en un idioma desconocido, sin contexto tangible, captura esta falta de comprensión fundamental que caracteriza a la IA actual.

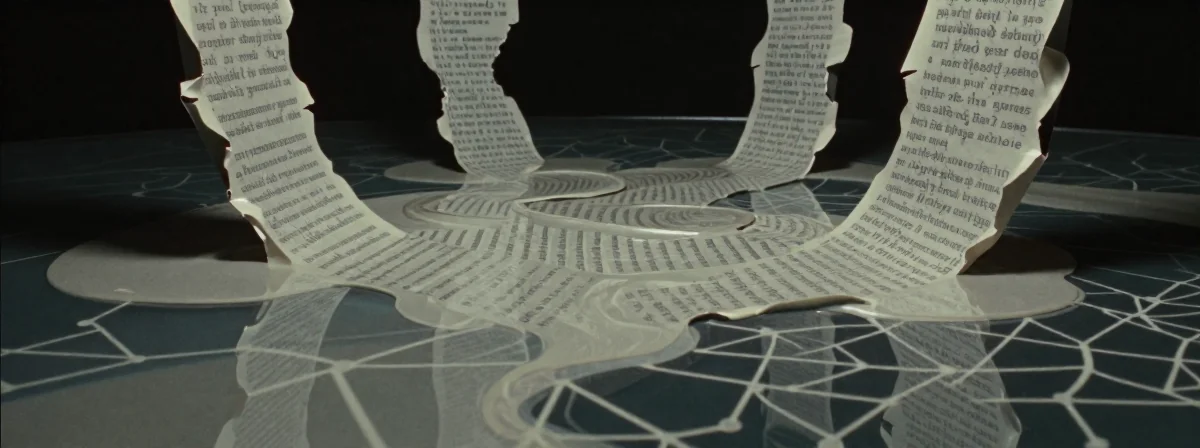

No obstante, la tensión persiste. Si bien reconocemos estas diferencias, la experiencia de interactuar con la IA a menudo nos deja con una sensación de… algo que falta. Esa sensación puede traducirse en la etiqueta “slop”. Y aquí es donde entramos en un terreno filosófico: ¿qué es lo que perdemos cuando nos acostumbramos a este tipo de interacción? ¿Es la pérdida de la imperfección humana, de la originalidad espontánea, de la necesidad de esfuerzo creativo? La preocupación no es solo sobre la calidad del contenido, sino sobre el impacto que esta creciente dependencia y aceptación de la generación automática pueda tener en nuestra propia capacidad para pensar, crear y comunicarnos de manera profunda.

¿La IA nos hace más predecibles?

Si adoptamos la perspectiva de que usar “AI Slop” refleja una forma de pensamiento predictivo, ¿qué nos dice eso sobre nosotros? ¿Estamos, en nuestra reacción a la tecnología, confirmando una de sus características más criticadas? Es una reflexión incómoda que nos obliga a mirar no solo a la IA, sino también a nuestros propios patrones de pensamiento y comunicación. Tal vez la verdadera lección no sea si la IA es “slop”, sino si nuestra propia reacción a ella revela una falta de flexibilidad o profundidad que deberíamos cuestionar.

¿Perdemos algo más que palabras?

Más allá de la polémica sobre la etiqueta “AI Slop”, la proliferación de la IA plantea preguntas fundamentales sobre nuestra relación con la tecnología. Estamos en una encrucijada donde la conveniencia y la capacidad de la IA se enfrentan a preocupaciones serias sobre privacidad, control, desinformación y, quizás lo más profundo de todo, la preservación de nuestra propia humanidad en el acto de crear y comunicar. La discusión sobre “AI Slop” sirve como un espejo, reflejando no solo nuestras críticas a la tecnología, sino también nuestras propias actitudes, miedos y, quizás, nuestras propias limitaciones en un mundo cada vez más automatizado. La tecnología avanza a pasos agigantados, pero la comprensión de sus implicaciones y nuestra capacidad para navegar su impacto de manera consciente y ética parece no mantener el ritmo. La pregunta no es solo qué es “slop”, sino qué estamos dispuestos a perder en nuestra carrera hacia adelante.